Sehen, was die KI denkt

Der Blick in neuronale Netze

Künstliche Intelligenz ist längst in unserem Alltag präsent und dringt in immer mehr

Bereiche vor. Fortschritte im KI-Bereich beruhen vor allem auf der Verwendung neuronaler Netze. Vergleichbar mit der Funktionsweise des menschlichen Gehirns verknüpfen sie mathematisch definierte Einheiten miteinander. Doch bisher wusste man nicht, wie ein neuronales Netz Entscheidungen trifft. Forschende des Fraunhofer Heinrich-Hertz-Instituts HHI und der Technischen Universität Berlin haben nun eine Technik entwickelt, die erkennt, anhand welcher Kriterien KI-Systeme Entscheidungen fällen.

Heute gibt es kaum noch einen Bereich, in dem künstliche Intelligenz (KI) keine Rolle spielt, sei es in der Produktion, der Werbung oder der Kommunikation. Viele Unternehmen nutzen lernende und vernetzte KI-Systeme, etwa um präzise Nachfrageprognosen anzustellen und das Kundenverhalten exakt vorherzusagen. Auf diese Weise lassen sich beispielsweise Logistikprozesse regional anpassen. Auch im Gesundheitswesen bedient man sich spezifischer KI-Tätigkeiten wie dem Anfertigen von Prognosen auf Basis von strukturierten Daten – etwa bei der Bilderkennung. So werden Röntgenbilder als Input in ein KI-System gegeben, der Output ist eine Diagnose. Das Erfassen von Bildinhalten ist auch beim autonomen Fahren entscheidend, wo Verkehrszeichen, Bäume, Fußgänger und Radfahrer fehlerfrei erkannt werden müssen. In solch sensiblen Anwendungsfeldern müssen KI-Systeme absolut zuverlässige Problemlösungsstrategien liefern. Bislang war es jedoch nicht nachvollziehbar, wie KI-Systeme Entscheidungen treffen. Zudem basieren die Vorhersagen auf der Qualität der Input-Daten. Mit der Layer-Wise Relevance Propagation (LRP) haben Forschende am Fraunhofer-Institut für Nachrichtentechnik, Heinrich-Hz-Institut, HHI, und der Technischen Universität Berlin nun eine Technik entwickelt, die KI-Prognosen erklärbar macht und somit unsichere Problemlösungsstrategien aufdeckt. Die Weiterentwicklung der LRP-Technologie, die sogenannte Spectral Relevance Analysis (Spray) identifiziert und quantifiziert ein breites Spektrum erlernten Entscheidungsverhaltens und erkennt somit auch in riesigen Datensätzen unerwünschte Entscheidungen.

Neuronale Netze interpretieren

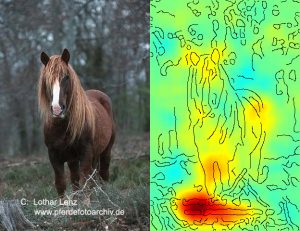

In der Praxis identifiziert die Technik einzelne Input-Elemente, die für eine Vorhersage genutzt wurden. Wird also beispielsweise ein Gewebebild in ein KI-System eingegeben, so wird der Einfluss jedes Pixels auf das Klassifikationsergebnis quantifiziert. Die Vorhersage, wie ‚krebsartig‘ oder ’nicht krebsartig‘ das Gewebebild ist, wird also mit der Angabe der Basis für diese Klassifikation ergänzt. „Nicht nur das Ergebnis soll korrekt sein, sondern auch der Lösungsweg. Bislang wurden KI-Systeme als Black Box angewendet. Man hat darauf vertraut, dass sie das richtige tun. Mit unserer Open-Source-Software ist es uns gelungen, die Lösungsfindung von KI-Systemen nachvollziehbar zu machen“, sagt Dr. Wojciech Samek, Leiter der Forschungsgruppe ‚Machine Learning‘ am Fraunhofer HHI. „Mit LRP visualisieren und interpretieren wir neuronale Netze und andere Machine Learning-Modelle. Wir messen den Einfluss jeder Eingangsvariablen für die Gesamtvorhersage und zerlegen die Entscheidungen des Klassifizierers“, ergänzt Dr. Klaus-Robert Müller, Professor für Maschinelles Lernen an der TU Berlin.

Lösungsweg erkennen

Nur wer versteht, wie neuronale Netze funktionieren, kann den Ergebnissen vertrauen. Dass KI-Systeme nicht immer sinnvolle Lösungswege finden, ergaben die Tests der Forscherteams. Beispielsweise klassifizierte ein renommiertes KI-System Bilder anhand des Kontextes. Es ordnete Fotos der Kategorie Schiff zu, wenn viel Wasser im Bild zu sehen war. Die eigentliche Aufgabe, Schiffe zu erkennen, löste es nicht, auch wenn die Mehrzahl der Bilder korrekt identifiziert war. „Zahlreiche KI-Algorithmen wenden unsichere Strategien an und kommen zu wenig sinnvollen Lösungen“, resümiert Samek das Ergebnis der Untersuchungen.